Radxa Fogwise 1684X Mini 微服务器搭载算丰第四代智算处理器1684X,高达32Tops INT8峰值算力。支持边缘端部署ChatGLM2-6B、AIGC、Llama、SAM等超大参数模型。无需昂贵的硬件设备和繁琐的配置环境,一根网线即插即用,大大降低使用门槛,保障数据的安全和隐私。可广泛用于教育、文旅、工业、园区、物联设备等。

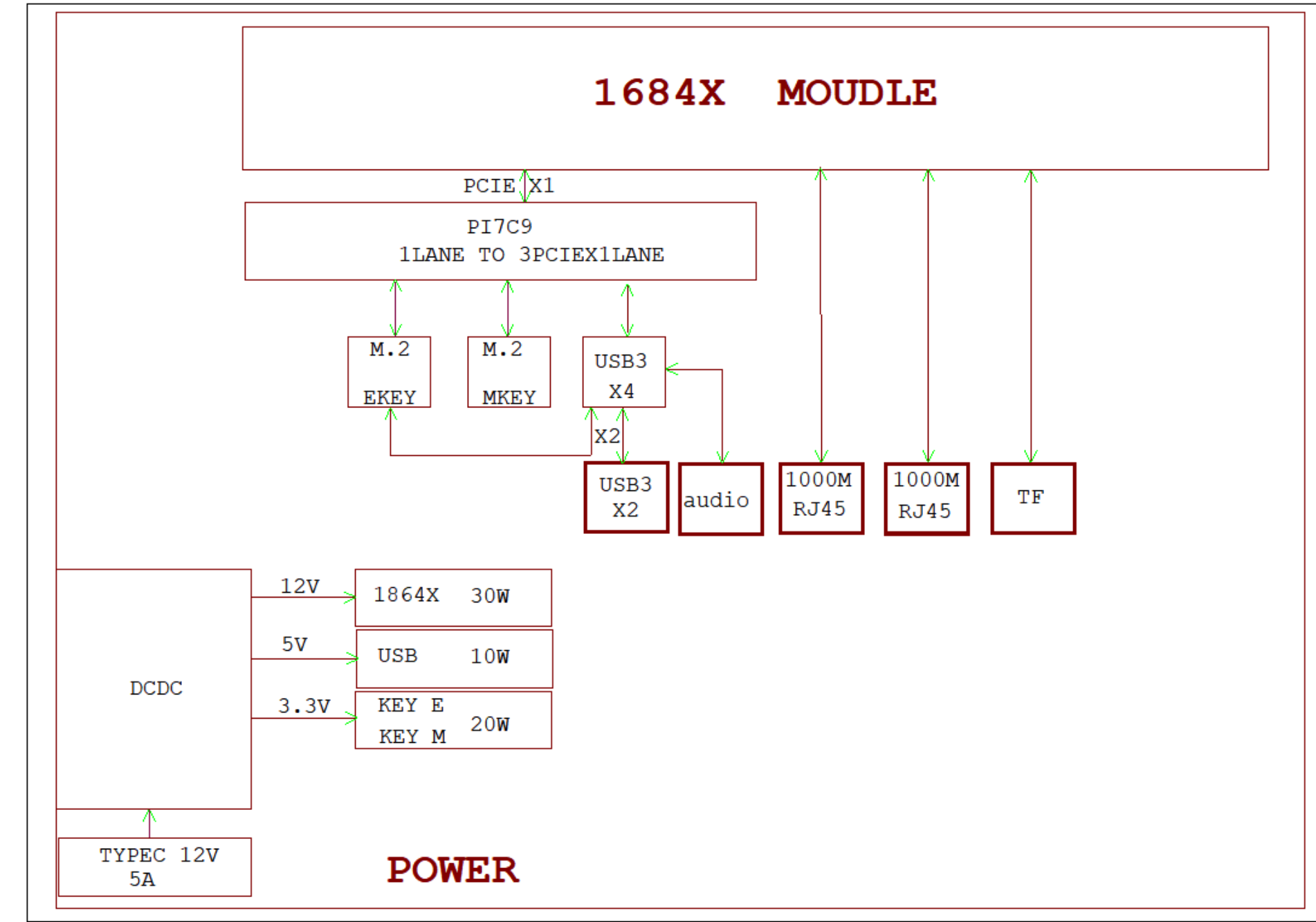

Radxa Fogwise 1684X Mini 是一款跨越式的AI边缘计算设备,搭载 SOPHON AI处理器 BM1684X,拥有八核ARM Cortex-A53,最高主频2.3GHz;拥有高达32Tops(INT8)算力、或16TFLOPS FP16/BF16)算力、或2Tops(FP32)高精度算力,,16GB LPDDR4X 内存,64GB eMMC;INT8算力高达32TOPS,支持主流编程框架(包括 TensorFlow, Caffe, PyTorch,Paddle, ONNX, MXNet, Tengine, and DarkNet),开放SDK,提供一站式AI开发包,工具链完备易用度高,算法可轻松部署,可低成本迁移算法至Radxa Fogwise 1684X Mini。Radxa Fogwise 1684X Mini 具备双1000Mbps RJ45 Port;M.2 E Key for WI-FI / BT Module;M.2 M Key for NVMe SSD;双 USB 3.0;一个USB-C;支持外接Mic和Speaker。

开发资料

TPU-Milr: https://tpumlir.org/docs/quick_start/index.html

Demo参考:https://baifengbai.github.io/airbox_wiki/

课程资料:https://sophon.cn/curriculum/description.html?category_id=47

套件内容:金属外壳+1684X核心板+1684X Mini底板

活动时间:

1. 申请报名:2023年 10 月 16 日 - 2023年 11 月 30 日

2. 公布名单:2023年 11 月 30 日

3. 发货日期:2023年 11 月 30 日

4. 试用期限:2023年 11 月 30 日 - 2023年 12 月 30 日

活动流程:

1. 产品申请:点击免费申请按钮即可报名。请认真填写申请理由,提交有创意的试用计划,大致的实现过程和应用场景,展示丰富的过往项目经验和网络影响力。

2. 筛选:厂商根据申请者填写的试用计划和论坛活跃度两个维度进行筛选。

3. 名单公布:试用名单将在活动页公布。

4. 试用通知:名单公布后工作人员将以短信 / 邮箱 / 电话等方式通知申请成功者。

5. 产品寄送:联系到试用者,双方确认规则后,将产品快递给试用者,具体到货时间以实际物流为准。

6. 试用报告:收到开发板后,需按要求定期上传评测报告(图文 / 视频)至电子发烧友社区,试用报告要求100 % 原创,抄袭会被封杀哦。

7. 产品回收:请收到开发板的用户在规定时间内完成试用报告并上传至电子发烧友论坛,如发现未完成试用报告上传发布,将会要求您退回开发板。

8. 优秀试用帖评选:将从试用报告质量,回复量等方向评选。

9. 申请后可及时添加工作人员(微信elecfans123),方便后续及时发放试用。

试用报告:

1. 试用者收到开发套件后,进行学习评估,并在发烧友社区发帖/硬声APP发视频记录开发板的试用过程,分享试用心得。经过试用评测学习后,试用者使用开发套件并在论坛发帖纪录项目过程、心得。试用报告要求如下:

试用报告可分为:项目概述、软件调试、硬件接入、视频演示,不少于500字+3张图片。

2. 报告形式:标题格式【算能RADXA微服务器试用体验】+自拟标题;视频演示可分为:应用演示视频、调试演示视频。

3. 试用周期内如无特殊原因,要求一周上传一篇试用报告至算能开发者社区。

4.本次试用活动要求每位开发者需完成一个完整项目,并上传完整的应用方案DEMO、样例,至少上传4篇开发内容+1个演示视频

5.如未按要求上传相应内容,开发套件将被收回,并取消活动参与资格。

活动说明:

1.本次试用不包含拉票环节。

2.产品试用结束后,完整参与试用,可免费获得开发板。(试用报告积极完成,不存在水贴现象)

3.试用周期内如无特殊原因,要求一周上传一篇试用报告至电子发烧友社区。

4.试用活动结束前,申请者应将完整的应用方案DEMO(含视频)上传至硬声APP,每位开发者需共上传4篇开发内容+1个开发视频或应用方案视频。

5.如未按要求上传相应内容,开发套件将被收回,并取消后续活动参与资格。

6.技术支持:收到开发板后,请第一时间联系平台客服进入技术交流群,技术问题将由技术工程师专门解答。

7.如遇放假、快递停发等特殊情况,工作人员将会另行安排寄送时间,并通知相应开发周期。

8.若因突发状况,无法继续完成试用,以及收到套件的15天内,若没有更新内容,请主动与企业或者平台客服协商退还,方便其他网友继续试用。

9.活动过程中,套件所有权归活动发起者,试用者只拥有套件使用权; 若在使用过程中出现恶意损坏开发套件的行为,请原价赔偿

10.电子发烧友拥有最终解释权!

算能专注于AI、RISC-V CPU等算力产品的研发和推广应用,以自研产品为核心打造了覆盖“云、边、端”的全场景应用矩阵 ,为城市大脑、智算中心、智慧安防、智慧交通、安全生产、工业质检、智能终端等应用提供算力产品及整体解决方案 。